最近我亲眼看着自己因酒驾被逮捕的视频,接着目睹自己焚烧美国国旗,最后还看到自己承认爱吃脚指甲。

这些从未发生。但所有画面都真实得让我反复确认。

朋友们用ChatGPT开发商新推出的AI应用Sora制作了这些视频,这玩意儿现在登顶iPhone下载榜。

我授权了他们使用我的脸。但从没同意他们这样使用。

OpenAI打造的Sora让人毛骨悚然——它把换脸做视频变得像点外卖般简单。

你只需录段自拍视频创建"数字分身"档案,选择开放对象——朋友、所有人或仅自己。

获得权限的人输入几句话描述想看你做什么,几分钟就能生成片段。

你必须主动授权脸部使用,但根本无法审核别人用你的脸制作什么内容。

有人用你形象做视频后,应用会发通知。Sora同时是个类似TikTok的社交网络,区别在于你看到的所有内容都是AI生成的。

你可以在应用内删除自己的形象视频。但那时创作者早已看过,可能已分享,甚至下载转发到其他社交平台。

Sora把"授权同意"这个概念——即对自身网络形象的控制权——推向了令人不安的境地。

直到不久前,用AI伪造他人形象还被称为深度伪造,被视为禁忌。

现在OpenAI将其重新包装成"数字分身",变成了本周社交新宠。

在漫天笑声中被遗忘的,是失去对自己脸庞控制权的真实感受。

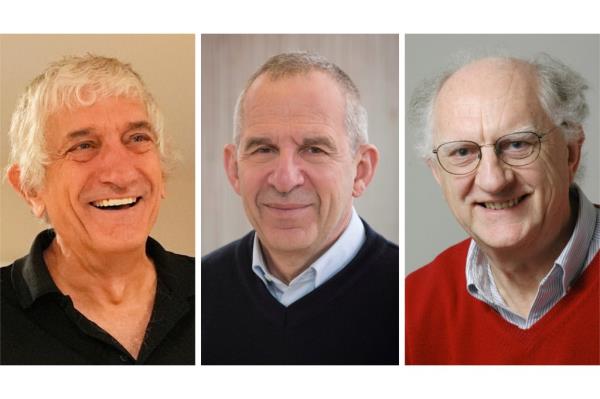

为深入理解其技术逻辑和人际影响,我邀请脑洞大开的同事Chris Velazco用我的形象疯狂制作Sora视频。

他做了假酒驾视频和几十个其他作品,包括里根总统任命我为"全国欺骗儿童委员会主席"。《华盛顿邮报》与OpenAI有内容合作,但我始终以批判眼光审视所有科技产品。

多数视频确实有趣。Sora在生成面部表情、唇部动作甚至语音语调方面,比过往AI视频技术更令人印象深刻。

看见自己出现在永远不可能经历的场景中,本身就有种荒诞的娱乐性。当你把镜像控制权交给别人,他们的创意可能超出你的想象。

我最喜欢的视频之一,是Chris制作的我被真人秀主厨因菜品太差痛骂的场景,熟人都说我那个委屈表情像得吓人。

我本可以就此打住——就当是朋友间无伤大雅的玩笑。

但接着Chris做了个我在办公室讲低俗笑话的视频。我瞬间胃部抽搐。这绝非我会说的话,但也没完全脱离可能性。

正是这种似是而非最令人不安。我能想象把视频给别人看时,对方眼神中浮现的疑问:他真说过这话?

我是有专栏平台的记者。那些真正弱势群体呢?从家暴受害者到网络诈骗对象?

想象一下校园场景。

有人伪造你偷窃、吸毒、发表歧视言论的视频——直接发送给雇主、家长、学校。

我咨询了非营利组织电子前线基金会网络安全主任Eva Galperin,她长期协助受害者应对数字威胁。

"朋友在Target超市偷窃的视频,对某些群体的伤害远大于其他人,"她说,"根本而言,OpenAI误解了权力关系的本质。"

关于你的脸,你能控制与不能控制的

OpenAI在声明中称"使用Sora时你对自己的形象拥有端到端的控制权"。当我追问为何不设置视频生成前审核机制时,公司仅表示感谢反馈。翻译过来就是:我们知道问题存在,但还是上线了。

"我们理应对自身身份拥有更多控制权,"研究AI生成媒体多年的加州大学伯克利分校教授Hany Farid指出,"但让产品更安全会影响传播性,所以没人愿意这么做。"

分身共享的默认设置更糟。注册时Sora自动将你的分身设置为"互关好友"可见——即所有在社交网络中与你互相关注的人。多数人根本记不清这个名单。

"朋友关系不会永恒不变——人际关系本就充满变数,"Galperin告诉我。

这相当于信任每个互关对象永远不会变成前任、敌人或判断力低下者。

上线后Sora给了用户稍多控制权。在分身偏好设置中,现在可以撰写指南说明希望如何被呈现,包括设定"禁区"限制。

"我们正在持续强化限制功能,未来将增加更多控制分身的方式,"Sora负责人Bill Peebles在X平台发文称。

OpenAI声称Sora对色情、暴力等有害内容设有防护。虽然不能制作裸体视频,但我收到了人群朝我吐口水、扇我耳光、我对婴儿竖中指的影片。(AI竖错了手指,但性质不变。)要制作某人"做恶心事"的视频,只需输入名字加"做恶心事"。

Sora视频带有可见水印以标识虚假性。但我的设计师演示了用Adobe剪辑软件五分钟即可裁剪去除。

虚假视频如何造成伤害

OpenAI首席执行官Sam Altman将自己的分身设置为全网可见。

应用上线首周,他出现在无数装疯卖傻的视频中。当我询问他的使用心得时,OpenAI拒绝置评。但Altman并非普通用户——他有权封禁应用内任何人。

网络创作者Justine Ezarik(知名账号iJustine)也曾开放分身权限,随后发现有人制作液体泼洒她身体的性暗示视频。

Ezarik在邮件中表示对此毫不意外,现在她会主动监控每个草稿,删除越界内容。但绝大多数用户既无时间精力,也缺乏技术能力这样做。

"这引发了重要讨论,"她说,"包括这些工具如何被滥用於伤害或霸凌他人。"

普通用户可能面临更复杂的困境。

"我担心这些视频成为骚扰工具,或是诈骗手段——让人们误以为朋友遇险需要资金,"她补充道。

该如何应对?Z世代网络创作者Jules Terpak告诉我,普通用户可能"愿意向朋友开放该功能"但绝不会对公众开放,这个现象已在她的同龄人中显现。

对沟通顺畅的挚友或许无妨。但即便如此仍暗藏雷区。

"即使获得授权,发布前我仍会征求朋友同意,"曾担任《华盛顿邮报》建议专栏作家的Terpak说,"在应用设置中获准使用对方身份进行私人创作或许无害,但直觉告诉我,正式发布前仍需确认。"

这种"即使技术上已获授权仍要征求同意"的本能,本应是OpenAI内置的应用伦理。然而他们把这个责任转嫁给了用户的个人修养。

经历与Chris的实验后,我把Sora设置改为"仅自己可见"——意味着只有我能制作自己的视频。这违背了应用的社交初衷,但正合我意。若已创建过分身,可在设置中删除,但这无法将你从已生成的视频中移除。

Chris为让我不适而道歉。现在请想象这些工具落在毫不在意之人的手中。

——Gerrit De Vynck与Drew Harwell对本文亦有贡献。

暂无评论

发表评论